你还在卷提示词(Prompt)?不好意思,这届大模型根本不吃这一套了。

今天刷到一篇科技圈神文,评论区全是“+1”、“转发收藏”,甚至引来了 Karpathy、Tobi Lutke 等大佬站台点赞,直言一句:

“Prompt 工程的格局小了,真正决定 AI Agent 上限的是——Context Engineering(context engineering)。”

难道 Prompt 工程真的“过气”了吗?什么是 Context 工程?为啥连 DeepMind 和 Shopify 的大佬们都一边倒站队它?这背后,或许藏着下一代 AI 应用的真正密码。

Prompt不香了?Context才是Agent的决定因素!

文章出自 Google DeepMind 的 AI 开发者关系工程师 Philipp Schmid——他正带领团队构建 DeepMind 首个 AI 开发者关系部门,任务只有一个:把最前沿的大模型成果推向全世界开发者。

他的核心观点震撼圈内:

“与其打磨提示词,不如精心设计上下文。这才是让 AI 真正聪明的关键。”

想想你是不是也有这样的经历:

- 绞尽脑汁写了“完美提示词”,结果模型还是给出一段没灵魂、像背课文一样的回答;

- 明明上下文很复杂,但模型回答却浅尝辄止、甚至完全跑题。

问题出在哪?在于 大模型就像一个记忆力有限的语言引擎,它并不是不聪明,而是——你没喂给它对的信息。

而这正是“context engineering”的价值所在:让模型看清问题全貌,给出更像人类的判断与回应。

大佬力挺:“Prompt Engineering”只是入门,“Context Engineering”才是未来

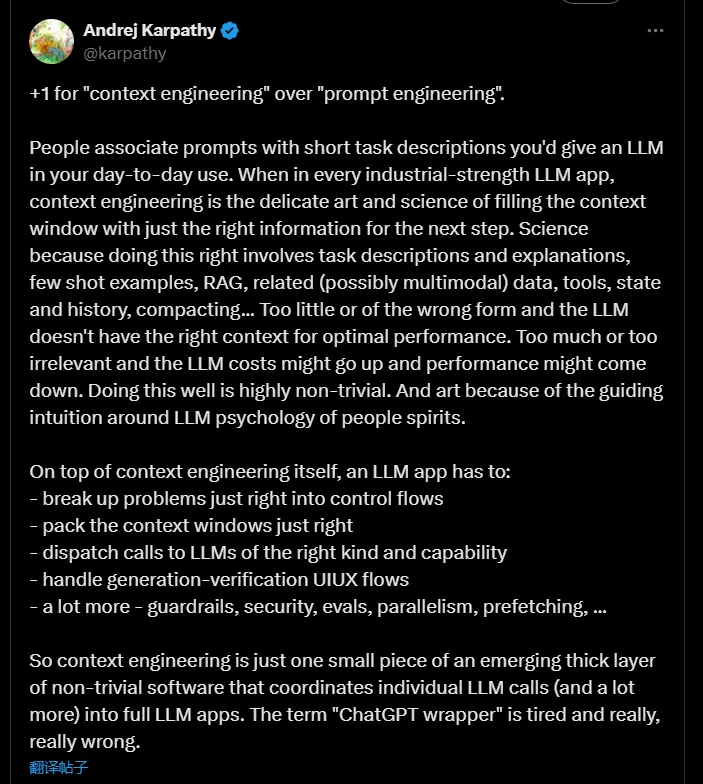

这不只是 DeepMind 一家之言,圈内神级大佬 Karpathy(前 OpenAI、特斯拉 AI 负责人)早已表态支持。

他指出:

“context engineering是一门构建‘智能体记忆系统’的艺术与科学,远比一行 prompt 更加复杂和系统。”

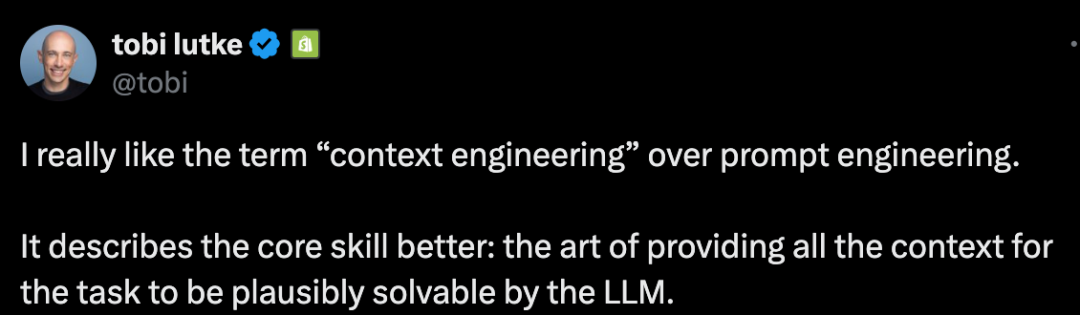

甚至 Shopify 的 CEO、著名的“夜间黑客”Tobi Lutke 也发推大赞:

“我更喜欢context engineering这个说法,它更准确地描述了我们真正需要掌握的核心能力。”

他们都提到一个关键点:提示词只是用户层的小把戏,真正的工业级 AI 应用,需要系统性地组织上下文。

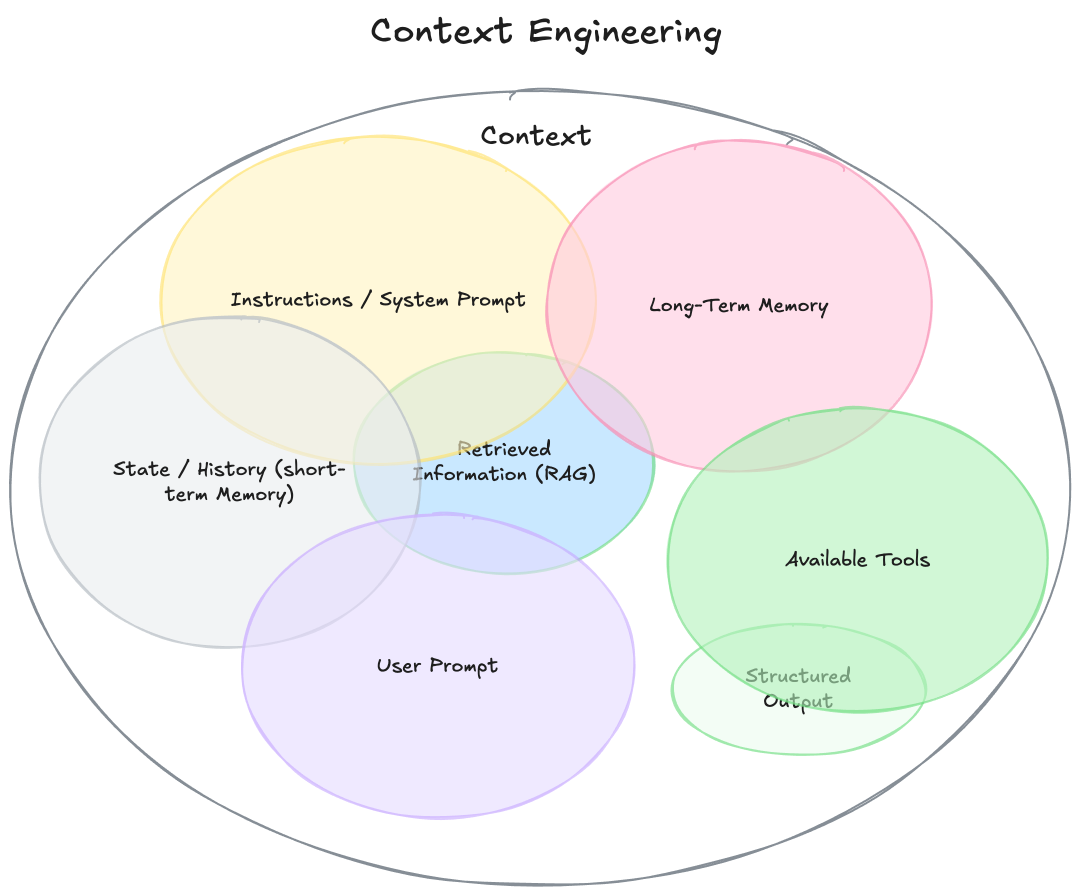

上下文≠一句话,完整构建包含7大模块!

Philipp Schmid 在文中详细拆解了 一个真正“有上下文”的 AI 系统,应该包含哪7种内容:

- 系统提示(System Prompt):提前定义模型的行为规则、身份、风格等。

- 用户提示(User Prompt):当前用户发出的任务。

- 短期记忆 / 历史(State / History):对话上下文、之前的互动记录。

- 长期记忆(Long-Term Memory):跨会话记住的信息,如用户偏好、业务背景等。

- 外部信息检索(RAG):模型从数据库或搜索引擎中抓取的实时知识。

- 可调用工具(Available Tools):模型可使用的功能接口,如发送邮件、下单、查库存。

- 结构化输出(Structured Output):输出内容的标准格式,比如 JSON、Markdown

如果说 Prompt 是一颗子弹,那 Context 就是整套武器系统,影响着这颗子弹能否精准命中目标

从“机器人回复”到“真人助理”,差的只是上下文

举个栗子,看看上下文的魔力:

你问 AI 助理:“明天能不能安排个会议?”

- 只提供这一句话,它可能机械回复:

- “明天我有空,请问您想几点开始?”

- 提供完整上下文(你的日程表、对方身份、历史邮件、常用语风格)后,AI 的回应会变成:

- “嘿 Jim!我明天全天都排满了。周四上午有空,合适吗?我已经发了个邀请,看看是否合适。”

是不是像真人秘书一样聪明了?

这就是 从“便宜Demo”升级为“神奇AI”的关键分水岭:不是换了大模型,而是加了上下文!

Prompt工程 vs Context工程,有何本质不同?

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

简单说,Prompt 工程是“如何说服模型”,而 Context 工程是“如何让模型理解全貌”。

在大模型能力越发强大的今天,限制它的往往不是智能,而是你给的信息不够多、格式不对、时机不准。

有人质疑:“Context Engineering”是换皮炒作?

当然,也有不少开发者泼了点冷水:

“上下文、提示词,本质上都是 Token 输入,模型不会区别对待。”

还有人说:

“所谓 Context Engineering,其实就是 Prompt 的系统化包装。”

这就像黑盒巫术——“调调试试、试试调调”。

不过就像编程一样,有人能写出 Hello World,也有人能构建分布式系统。context engineering看似炒概念,实则拼的是工程力。

结语:Prompt 的淡出,是趋势也是必然

随着 Agent 框架、RAG 技术的成熟,大量 AI 应用都在自动生成 prompt,开发者反而更需要掌握的是如何构建一个上下文生态:

- 什么信息该保留,什么该剪裁?

- 什么时候调用什么工具?

- 如何防止 context 腐烂(context rot)?

- 怎样设计信息结构,避免 GIGO(Garbage In, Garbage Out)?

这,才是真正的下一代 AI 工程师该卷的方向。

你是否已经在项目中用上了context engineering?是“真香”还是“玄学”?欢迎在评论区一起聊聊你的经验、踩坑故事,或者——晒晒你的Magical Agent!

记住一句话:模型再强,也得靠你“喂得好”才行。

本文由开放猫和子木联合共创,往期资料,回复“开放猫AI"添加下方二维码免费领取。